Oppgavene KI-agenter klarer å gjøre blir stadig lengre. Hvilke konsekvenser har dette for samfunnet?

METR rapport

Språkmodeller som OpenAI's GPT4o brukes av millioner av mennesker for å svare på spørsmål. Men språkmodeller har lenge strevd med å gjøre ting. OpenAI's GPT4o kan svare på spørsmål om kvantemekanikk, men den klarer ikke å sende en email med noen grad av pålitelighet.

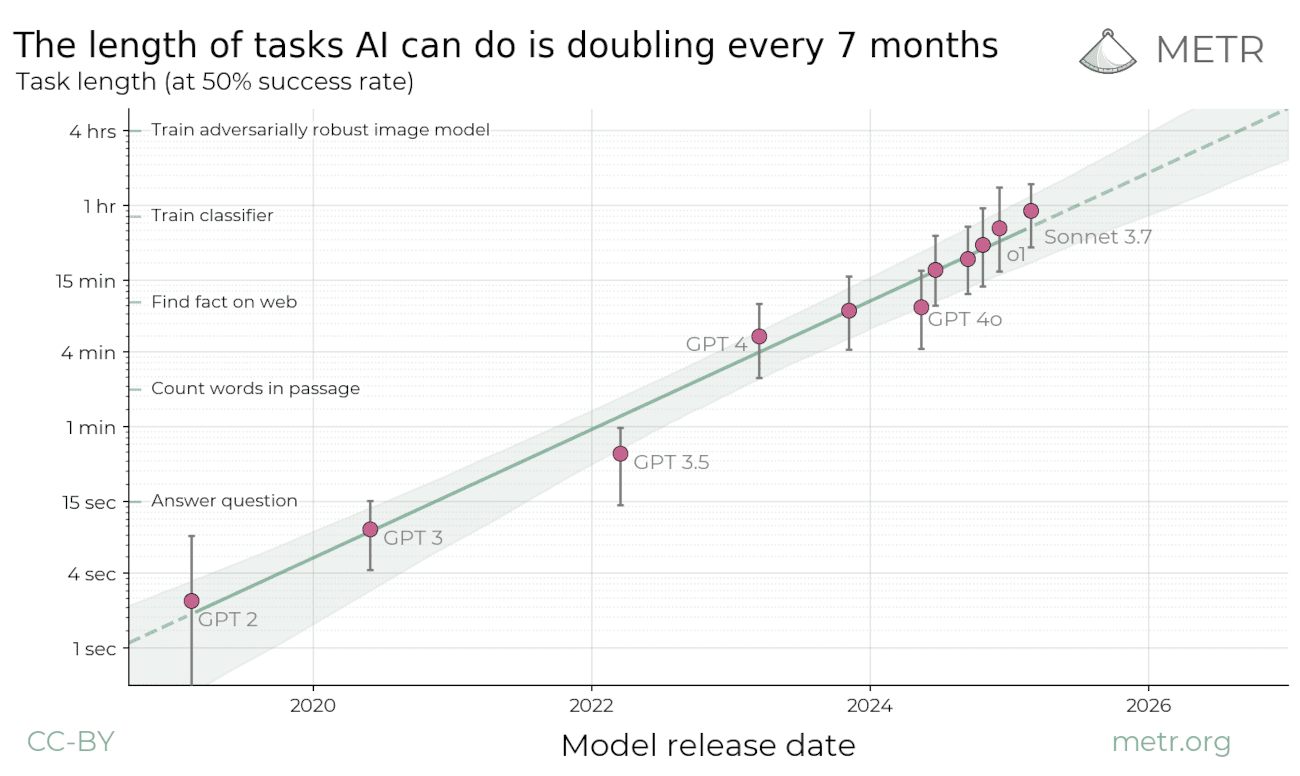

For litt over to månder siden publiserte forskningsenteret METR en rapport som antyder at denne antagelsen antakeligvis ikke kommer til å være sann spesielt lenge. METR's rapport viser at lengden på oppgaver KI-agenter kan gjøre dobler seg omtrent hver sjuende måned.

Om man ekstrapolerer trenden fra METR utover, finner man at KI-agenter vil være konkurransedyktige med mennesker på oppgaver som varer opptil en måned i 2030.

Konsekvenser

Om denne trenden holder vil det ha enorme konsekvenser. KI-modeller som kun svarer på spørsmål kan være veldig nyttige, men de er relativt trygge. KI-agenter som kan planlegge og utføre mål autonomt medfører mye større risikoer. Tenk på Cyberangrep: Avanserte cyberangrep er per nå utenfor KI-modellers evner, men om trendene holder vil dette raskt endre seg. Når modeller har muligheten til å utføre slike angrep kontinuerlig og uten menneskelig påsyn vil risikonivået til KI-systemene bli mye høyere.

Og dette er i det store bilde ikke den største faren med avanserte autonome KI system. Evnen til å utføre komplekse oppgaver over uker eller måneder, slik METRs framskrivninger antyder for slutten av tiåret, åpner døren for agenter som kan utvikle og implementere langsiktige strategier utenfor menneskelig kontroll. Slike systemer kan, hvis deres mål ikke er perfekt på linje med våre, føre til storskala ulykker, manipulere samfunnsinstitusjoner, eller utvikle farlige teknologier på måter vi ikke kan forutse eller forhindre